「ChatGPT」がもたらす人類の顛末(その2) ~三島由紀夫の「懸念」を越えて~ (IISIA研究員レポート Vol.106)

前回は、「ChatGPT」がもたらす短期的な影響を教育現場での懸念を中心に概観してきた。では、その長期的な影響により人類にはいかなる顛末が待っているのであろうか。

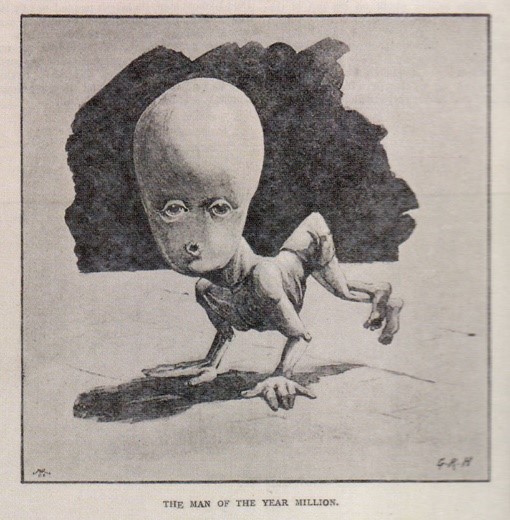

SF作家が描く未来の人類像として、様々なイメージが“喧伝”されているが、その中でも古典的なヴィジョンとしては、H・G・ウエルズが発表した「The Man of the Year Million(数百万年後の人間)」が有名である。これは、下図のとおり、脳が高度に発達し、手足が極端に退化した人類をイメージしている。

(図表:The Man of the Year Million)

(出典:Jesse Ramírez)

しかし、「ChatGPT」による思考力の低下や、動画視聴がメインとなる中で、むしろ脳機能の低下も懸念される。情報過多により脳の機能が追いつかなくなると、必要な情報を上手く取り出せなくなり、「ど忘れ」や「ケアレスミス」が多くなるという、いわゆる「スマホ認知症」がその典型であろう(参考)。

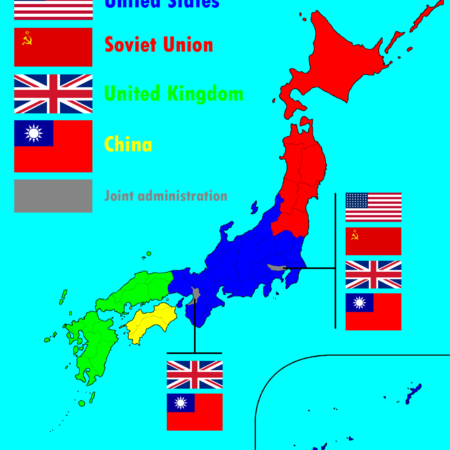

もっとも、そうした懸念を余所にして、「ChatGPT」や「SNS」といった、人類のツール、コミュニケーション手段はさらに発展していくのは自明の理である。そうした中で考えられるのが、「ハイブマインド(集合精神)」という人類の未来像である。これは、人々が脳と脳を何らかの手段で直結する通信方法を入手するなど人工的なテレパシー(telepathy)によって形成されるというヴィジョンである。個人の意思は、集団の欲求や女王バチのような中心的存在によってコントロールされ、自ら思考することなく集団生活を営むこととなるとされている(参考)。「ChatGPT」のような思考を代替するツールが普及すると、このような「ハイブマインド」型の人類像が一層現実味を帯びてくるのではないか。

(図表:映画『Hive Mind』)

(出典:Empresario)

もっとも「ChatGPT」が人類の思考を完全に代替するような完璧なツールというわけではない。「OpenAI」社が発表した「ChatGPT」の基となった「GPT-2」に関する論文“Language Models are Unsupervised Multitask Learners” (Brown et al., 2020) には、以下のような欠点も指摘されている(参考):

- While suggestive as a research result, in terms of practical applications, the zero-shot performance of GPT-2 is still far from use-able.(研究成果としては示唆的であるが、実用的な応用という観点からは、GPT2のゼロショット性能はまだ実用にはほど遠い)

- Even on common tasks that we evaluated on, such as question answering and translation, language models only begin to outperform trivial baselines when they have sufficient capacity.(質問応答や翻訳などの一般的なタスクでも、言語モデルが十分な性能を発揮するのは、些細なベースラインより優れている場合のみである)

例えば、上記のうち、ゼロショット性能(Zero Shot Learning)とは、機械学習における研究分野の一つであり、訓練データ中に一度も出現しなかったラベルを予測する問題設定のことを指す。それゆえに、「GPT-2」を基にしたチャットボットである「ChatGPT」も、これらの欠点を完全には克服しておらず、以下のような欠点が指摘されている(「ChatGPT」自身にその欠陥を聞いてみた):

(図表:「ChatGPT」が自ら指摘する欠点)

(出典:ChatGPT)

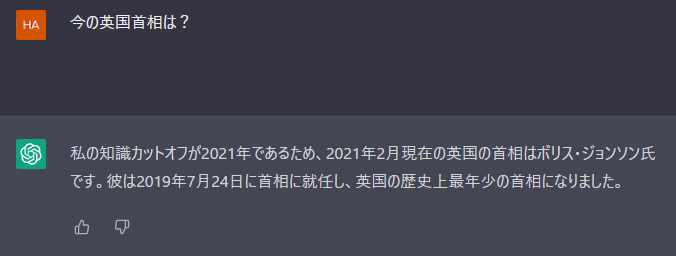

すなわち、「ChatGPT」では、去る2021年までに「内挿」されたトレーニング・データに基づいてしか応答することができず、それ以降の新しい事象については、答えられないのである。例えば、下図のように、現在の英国首相も答えられないのが現状なのだ。

(図表:「ChatGPT」に現在の英国首相を尋ねた結果)

(出典:ChatGPT)

このように、現状では「ChatGPT」も使い様によっては、大変便利で、仕事や学業の効率化に役立つが、その真偽は意識をもったヒトによって判断されなければならないと言えよう。

かつて、仏の文芸評論家ティボーデは、読者には「レクトゥール(普通読者)」と「リズール(精読者)」の2種類がいるとし、三島由紀夫は「レクトゥール」を「リズール」へ導くことの重要性を説き、また作家たるもの「リズール」たることから出発すると、その著書『文書読本』で説いた。

「ChatGPT」を賢く使える「リズール」にとっては、これは大変有用なものになるが、「レクトゥール」のようにこれを鵜吞みにしてしまうと、誤った知識を得ることにつながってしまう。況してや、SNSが発達し、短文での投稿や、ショート動画の視聴がメインとなり、「レクトゥール」すら存在しなくなった今、「ChatGPT」の存在は、「レクトゥール」以下の層をして更なる劣化をもたらすものとなろう。

他方で、「リズール」としても、単に「文章力がある」だけでは優位性にならず、真偽の判断の他、人工知能(AI)にはできないような付加価値の創造が求められよう。更には、そもそもの前提として、執筆をしたり、文章を読んだりする中で、いかにリフレクション(省察、振り返り、内省)できるかが根本的には重要となるのではないか。

(図表:著書『自省録』で思索や内省を書きとめたローマ皇帝マルクス・アウレリウス・アントニヌス)

(出典:Wikipedia)

グローバル・インテリジェンス・グループ リサーチャー

原田 大靖 記す

*本コラム内にある見解は、弊研究所の一致した見解ではなく、執筆者個人の見解を示すものである。

<無料メルマガ>

弊研究所についてより詳しく知りたい方は、こちらより是非、無料メルマガにご登録ください。

<コラムに関するアンケート>

こちらよりコラムに関するアンケートへご回答いただけますと幸いです。アンケートにご回答いただいた方に、弊研究所の分析ラインをまとめた「IISIAの見解」を無料でもれなくプレゼントいたします。

<これまでのコラム>

- 「ChatGPT」がもたらす人類の顛末(その1)~三島由紀夫の「懸念」を越えて~(IISIA研究員レポート Vol.105)

- 「欧州ワイン戦争」の最前線 ~気候変動により恩恵を受ける北欧勢とその行方~ (IISIA研究員レポート Vol.104)

- 2022年の回顧と2023年への展望 ~注目すべき6つのトレンドとは~ (IISIA研究員レポート Vol.103)

- “自戒”する「エコ・テロリズム」 ~背後にあるものとその末路とは~ (IISIA研究員レポート Vol.102)

- 「ザポリージャ・ショック」という悪夢 ~世界経済の凋落と“その先”にあるものとは~ (IISIA研究員レポート Vol.98)

- 「グローバルヘルス戦略」から見える近未来 ~我が国に求められる「次なる一手」とは~ (IISIA研究員レポート Vol.96)

- 経済制裁の「パラドックス」と「ジレンマ」 ~ドレズナーの“ゾンビ理論”から導く今後の展開~ (IISIA研究員レポート Vol.94)

- “ウクライナ・ファティーグ”という悲愴 ~「戦後処理」の歴史にみるポスト・ウクライナ戦争の「青写真」~ (IISIA研究員レポート Vol.91)

- クリーンな空気がハリケーンの原因か?~米系“科学ジャーナリズム”を読み解く~ (IISIA研究員レポート Vol.86)

- 「国際赤十字」という“聖域”~その光と陰~ (IISIA研究員レポート Vol.84)

- 「国連解体」への序曲 ~「次なるフェーズ」に突入したウクライナ戦争~(IISIA研究員レポート Vol.81)

- 新たな局面を迎えたウクライナ勢を巡る「危機」 ~「ソ連科学アカデミー」復権への道程か~ (IISIA研究員レポート Vol.78)

- 外資系ホテルの空白地帯・札幌に米系最上級ホテルが進出 ~押し寄せる「グローバル・マクロ」の波~ (IISIA研究員レポート Vol.75)

- 「華僑・華人ネットワーク」が織りなす世界史 〜中華圏ビジネスで成功するためのカギとは〜(IISIA研究員レポート Vol.66)

- 「ロシア・ゲート」に見え隠れする米リベラル系シンクタンクの影 (IISIA研究員レポート Vol.63)

- 「歴史」はオーストリア勢から変わる~またしてもそうなるのか?~ (IISIA研究員レポート Vol.61)

- ジョン・ソーントンとは何者か ~米中「グローバル共同ガヴァナンス」の真相~ (IISIA研究員レポート Vol.59)

- さらに揺れる「スイス・プライベート・バンク」の行方 (IISIA研究員レポート Vol.57)

- 「脱炭素」に直面するイラク勢の焦燥 (IISIA研究員レポート Vol.55)

- マネロン対策で我が国が「不合格」の真相 (IISIA研究員レポート Vol.53)

- アフガン情勢に我が国も無関心ではいられない理由 (IISIA研究員レポート Vol.51)

- 「戦国時代」に突入したインフラ支援 (IISIA研究員レポート Vol.49)

- 食糧安保のカギとなる「ウレア」の近未来 (IISIA研究員レポート Vol.48)

- 暴露された英国勢の新「世界戦略」~英軍の機密文書が“発見”された意味~(IISIA研究員レポート Vol.46)

- 新旧「大西洋憲章」を読み解く(IISIA研究員レポート Vol.44)

- パンデミックからの『出口戦略』を探る(IISIA研究員レポート Vol.40)