我が国の行政にマッチした大規模言語モデル(LLM)とは。(「IISIA技術ブログ」Vol. 5)

「組織に入ったならばまずはその組織の中における先輩メンバーたちの手伝いをする。しかも単純な作業から始めるのであって、最初から本格的に仕事の文書作りを任されるわけではない。いわば雑巾がけの時代がしばらくは続くわけであるが、その結果、徐々にその組織特有の言葉遣いとか、あるいは文章構成とかに慣れてくる。そうこうしている間に『それではちょっと書いてみるか、この文書?』と上司に言われ、指示されるがままに書いてみるがまずは上手くいかない。さんざん赤字を入れられ、最初は凹む。だが何とか歯を食いしばって頑張っている間に、文書作りが徐々に上達していく。そしてふと気づくと10年選手、20年選手となり、何時の間にか今度は後輩たちを相手に『なんでこんな文書が書けないのか?』と一丁前に文書添削をするようになっている。」

これがいわゆるOJT(=on the job training)の基本的な流れである。我が国でも昭和世代まではこの様な仕事の覚え方、特に会社など組織に入ってからそこで固有な文書作成のやり方をこうして覚えるのは当たり前であった。しかし今や時代は全く異なるのである。「少子高齢化」が当然となると、まずは教えてくれるはずの先輩の数が減って来る。他方で若手人財の獲得競争が激化すると、もはや「ウチは雑巾がけからやらさせています」等という組織に”金の卵”であるべき新卒者らはもはや見向きすらしないのである。その結果、それぞれの組織に固有であったはずの文書作成のやり方はものの見事に崩壊し始めている。今この瞬間はミドルマネジャーでも上の方を務め始めている、いわゆる「団塊ジュニア世代(1973年前後生まれの世代)」が大勢いるからそれぞれの組織において仕事が廻ってはいるのだ。だが、間もなくこれも崩壊し始めることが明らかだ。

もっともこうした我が国の組織現場における「実態」は、それが民間経済における話である限り、結局、「自然淘汰の範囲内だ」と片付けても良いかもしれないのだ。かの米系コンサルティング会社の”雄”であるマッキンゼーが「War for Talent」と題するレポートを掲げ、先進国を中心に少子化が進む結果、国境を越えた人財獲得競争が進むと喧伝してからもはや久しいのである。そうであっても手を打っていなかった民間企業にはもはや生き残る道は残されていないと言われても、これらの(我が国)企業はぐうの音も出ないというのが実際のところであろう。

だがしかし、ここでいう「組織」が行政の現場であるということになってくると話は大きく違ってくる。行政は私たちの支払う税金で成り立っている、公的なサーヴィス提供の現場である。そこが若手の人材難だからといって機能不全に陥ってしまっては全くもって困るのである。したがってそこでの文書作成については、少子化で若手が入ってこないとなっても何とかしなければということになってくる。我が国の民間経済において、大規模言語モデル(LLM)について喧伝されても今一つピンとこないにも拘わらず、連日連夜の様にマスメディアが報道をし続けるのには、他でもない明治維新以降、我が国の屋台骨を支えてきた行政の現場が少子化によってもはやにっちもさっちもいかないくらい人手不足になっているからであり、だからこそ、そうした行政の現場において大規模言語モデル(LLM)を活用して何とか延命が図れないかと模索されていることによるのである。

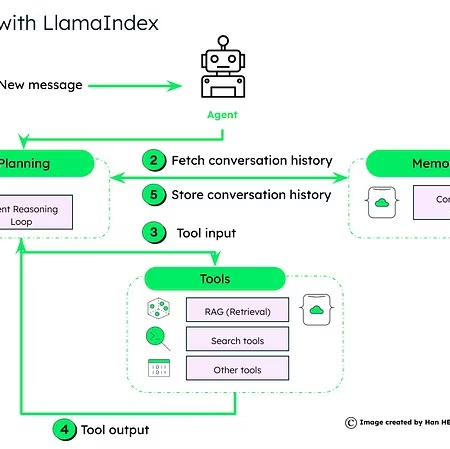

もっともここで話が一筋縄に進むのかというとそうでもない。なぜならば行政の現場に大規模言語モデル(LLM)を当てはめようとすると、直ちに1つの重大な課題に直面するからである。それは行政の現場における文書には「秘密文書」が含まれている一方、事前学習(pre-trained)を特徴とする大規模言語モデル(LLM)はそうした秘密文書を含む、行政文書全体を対象とした事前学習を当然にはしていないという課題なのだ。かのChatGPTも、GPT-3.5までは少なくとも2021年までに作成されたテキストを対象とした事前学習のみをベースに成り立っており、それ以降の出来事について質問をしても、そもそも「知らない」といった答えが返って来るか、あるいは極めて「不正確」な答えがだけが戻って来ることが良く知られている。そうである以上、自ずからテキスト生成系AIの研究は、それが実装される分野別(domain-specific)で使用されている独特の言い回しや単語、そして内容をより深く個別に事前学習させた大規模言語モデル(LLM)を創り出そうという動きに自ずから収斂してくることになる。

この様に言うからといって、現状の研究結果を踏まえる限り、「分野別に巨大化させたコーパスで学ばせれば学ばせるほど、的確な回答を返してくる大規模言語モデル(LLM)の構築には成功する」とは言えないことが分かっている。例えば[Hong et al. 2022]は様々な学問分野について大規模な言語モデルを作成した結果であるとして、次のとおり述べている。

Here, we report a broard study in which we applied 14 transformer-based models to 11 scientific tasks in order to evaluate how downstream performance is affected by changes along various dimensions (e. g., training data, model size, pretraining time, finetuning length). In this process, we created the largest and diverse scientific language model to date, ScholarBERT, by training a 770M-parameter BERT model on an 221B token scientific literature dataset spanning many disciplines. Counterintuitively, our evaluation of the 14 BERT-based models (seven versions of SchlarBERT, five science-specific large language models from the literature, BERT-Base, and BERT-Large) reveals little difference in performance across the 11 science-focused tasks, depite major differences in mode size and training data.

ちなみに余談であるが、そもそもテキスト生成系AIであるChatGPTのパフォーマンス評価を巡る指標(metrics)に関し、最近になって疑義が呈され始めている。GPT-4のテクニカル・レポート[OpenAI, 2023]はそのパフォーマンステストの結果について、米国における様々な学問分野での試験をGPT-4に解かせた結果を「集計数値(aggregate metrics)」をベンチマークとして示しているわけだが、この点について[Burnell et al. 2023]は問題視する。「全体として何点取れたのか」ではなく、「当該テストでどこを間違えたのか」を明示しない限り、評価としては不適当なのではないかというわけである。確かに[OpenAI, 2023]は何をどこでGPT-4は誤答したのかにつき、一切述べていない。確かにこれでは正しい評価指標(metrics)をもって測ったと断言するのには難ありと言わざるを得ないであろう。

話を元に戻す。―――行政の現場における特殊な用語やフレーズについて事前学習を行った大規模言語モデル(LLM)を検索すると、世界中でやはり難儀されていると見え、先行研究はほぼ全くない。しかし「ほぼ全く」というからには一つの例はあるのであって、管見の限り、この分野で先行しているのはイタリアである。[Auriemma 2023]はイタリア語に特化したモデルであるUmBERToに対して、銀行及び保険といった分野と並んで行政分野でのコーパスについても学習させ、BureauBERToを創り出したことを以下のとおり報告している。

BureauBERTo benefited from the vocabulary extension since it perfomed better than UmBERTo in the fill-mask task. Moreover, it benefited from domain adaptation, which is evident by observing the higher perfomances in fill-masking for already-known terms.

まだ限定的なタスクについてだが、明らかに行政分野に特有のコーパスを事前学習させたことで効果が上がったと報告している。もっともそれはどういった出自のコーパスであったのかというと、日常的に用いられている行政文書そのものではなく、イタリアにおける複数の自治体が制定した条例のテキストがそのベースになっていると[Auriemma 2023]は述べている。さらに次の様に[Auriemma 2023]が述べる時、果たして今後のこの論者らが目指す研究において、より一般的な行政文書であり、かつ、時には秘密文書を含むそのテキストをも含むのかは判然としないのである(むしろ可読性のテストなどを含め、法的なテキストへと特化しようとしている様にも見える点に留意しておきたい)。

In future work, we plan to assess the benefits of domain adaptation in the other sub-domais and in other downstream tasks, specifically tailored to the examined technical-bureaucratic domains.

行政の現場において行政文書は最終的に行政そのものが持つ権力の源泉であり、行政自身がその作成を自ら手放すことは到底あり得ないというべきである。だがそれがもはや加速度的に進展する「少子化」の中で行政そのものの存立を維持するためにやむなしとされる時、当然のことながらそこにはここでいう権力(power)の委譲という人類史上、画期となる現象が含みこまれるのであって、単に「知識・技能伝承」、あるいは「暗黙知の形式知化」といった枠組みを超えた、とてつもないインパクトを伴うことになるのは確実なのだ。そしてそれが可能になるのか否かは、究極のところ、大規模言語モデル(LLM)がどこまで改良されるのかにかかっているといっても過言ではない。その意味でその改良作業は先端技術の単なる社会実装を超え、根底から社会秩序を変え得るものとして、transformative innovationそのものであるということを本稿を通じて確認しておきたい。

2023年9月3日 帰路の新幹線車内にて

原田 武夫記す

(株式会社原田武夫国際戦略情報研究所 代表取締役CEO/グローバルAIストラテジスト)

(文献一覧)

Auriemma, Serena, et al. “BureauBERTo: adapting UmBERTo to the Italian bureaucratic language.” (2023).

Burnell, Ryan, et al. “Rethink reporting of evaluation results in AI.” Science 380.6641 (2023): 136-138.

Hong, Zhi, et al. “Scholarbert: Bigger is not always better.” arXiv preprint arXiv:2205.11342 (2022).

OpenAI, “GPT-4 Technical Report.” arXiv preprint arXif: 2303.08774 (2023).